Dostępność cyfrowa, Apple prezentuje nowe funkcje na rok 2025

15 maja przypada Światowy Dzień Wiedzy o Dostępności. Jest to międzynarodowe święto obchodzone co roku w tym miesiącu w celu podniesienia świadomości na temat kwestii dostępności cyfrowej. Firma Apple założyła dział zajmujący się rozwojem tych rozwiązań 40 lat temu. Ścieżka ta podążała za rozwojem technologii i urządzeń: pojawienie się funkcji lektora na iPhone'ach w 2009 r., „aparaty słuchowe MFi”. „Aparaty słuchowe stworzone dla iPhone’a” — czyli aparaty słuchowe kompatybilne z iPhone’em w 2014 r., tryb „czytnika ułatwień dostępu” ułatwiający czytanie użytkownikom z niepełnosprawnością wzrokową lub poznawczą w zeszłym roku itd.

Na rok 2025 wprowadzono szereg nowych funkcji, które pojawią się jeszcze w tym roku. Na początek będą to karty ułatwień dostępu w App Store, następnie Lens dla komputerów Mac, Braille Access i Accessibility Reader i wiele innych. Przez cały maj w wybranych sklepach Apple będą dostępne specjalne tabele prezentujące funkcje ułatwień dostępu w różnych urządzeniach. Oprócz organizowanych przez cały rok sesji Today at Apple poświęconych temu tematowi.

„Dostępność jest częścią DNA Apple” — powiedział Tim Cook, dyrektor generalny Apple. „Tworzenie technologii, która działa dla wszystkich ludzi, jest dla nas priorytetem i jesteśmy podekscytowani innowacjami, które dostarczamy w tym roku. Będziemy oferować narzędzia, które pomogą ludziom uzyskać dostęp do kluczowych informacji, odkrywać świat wokół nich i robić wszystko, co kochają”.

„W Apple mamy 40-letnią historię innowacji w zakresie dostępności i jesteśmy zdeterminowani, aby nadal poszerzać granice, wprowadzając nowe funkcje dostępności we wszystkich naszych produktach” — powiedziała Sarah Herrlinger, starsza dyrektorka ds. globalnej polityki dostępności i inicjatyw w Apple. „Wykorzystując potencjał ekosystemu Apple, funkcje te płynnie ze sobą współpracują, zapewniając użytkownikom nowe sposoby interakcji z rzeczami, na których najbardziej im zależy”.

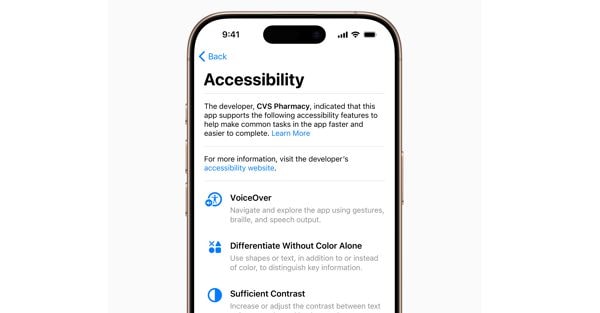

Karty ułatwień dostępu wprowadzają nową sekcję na stronach produktów App Store, w której wyróżnione zostaną funkcje ułatwień dostępu w aplikacjach i grach. Karty te zapewnią użytkownikom nowy sposób sprawdzenia, czy aplikacja jest dostępna, jeszcze przed jej pobraniem. Dzięki temu twórcy aplikacji będą mogli lepiej informować użytkowników i wyjaśniać im, jakie funkcje obsługuje ich aplikacja. Należą do nich m.in.: VoiceOver, sterowanie głosem, większy tekst, dobry kontrast, redukcja ruchu, transkrypcje i wiele innych.

Karty ułatwień dostępu dla aplikacji

Od 2016 roku aplikacja Magnifier na iPhone'a i iPada umożliwia osobom niewidomym lub słabowidzącym powiększanie obrazu, czytanie tekstu i wykrywanie obiektów w ich otoczeniu. W tym roku aplikacja Lens jest dostępna na komputerach Mac, aby ułatwić osobom słabowidzącym dostęp do prawdziwego świata. Aplikacja Lens dla komputerów Mac łączy się z aparatem, umożliwiając powiększenie dowolnego obiektu znajdującego się w pobliżu, na przykład ekranu lub tablicy. Aplikacja Lens współpracuje z kamerą Continuity w telefonie iPhone i podłączonymi kamerami USB, a także obsługuje odczytywanie dokumentów za pomocą aplikacji Desktop Overview.

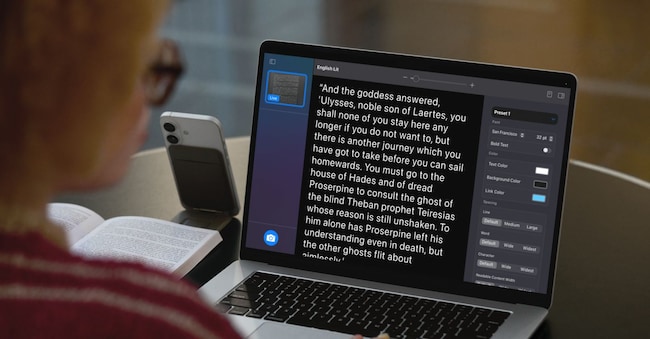

Dzięki wielu oknom sesji na żywo użytkownicy mogą wykonywać wiele zadań na raz, oglądając prezentację za pomocą kamery internetowej i jednocześnie czytając książkę w trybie przeglądu pulpitu. Dzięki niestandardowym widokom użytkownicy mogą dostosować jasność, kontrast, filtry kolorów, a nawet perspektywę, aby ułatwić czytanie tekstu i obrazów. Użytkownicy będą mogli także przechwytywać, grupować i zapisywać widoki, aby móc nad nimi później pracować. Ponadto aplikacja Lens dla komputerów Mac integruje nową funkcję ułatwień dostępu, Accessibility Reader, która przekształca tekst wykryty w świecie rzeczywistym na dostosowany, czytelny format.

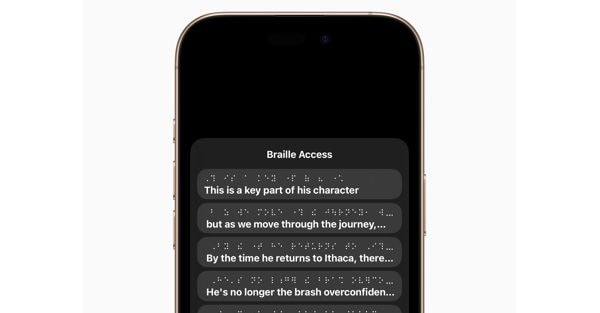

Czytanie brajlem

Braille Access przekształca iPhone'a, iPada, Maca i Apple Vision Pro w kompletne narzędzia do robienia notatek w alfabecie Braille'a, dotykowym systemie czytania i pisania, z którego korzystają przede wszystkim osoby niewidome lub słabowidzące. Dzięki wbudowanemu programowi uruchamiającemu aplikacje użytkownicy mogą łatwo otwierać dowolne aplikacje, wpisując tekst za pomocą „Screen Braille Input” lub korzystając z podłączonego urządzenia brajlowskiego. Dzięki aplikacji Braille Access możesz na bieżąco robić notatki w alfabecie Braille'a i wykonywać obliczenia za pomocą kodu Braille'a Nemetha, często stosowanego na lekcjach matematyki i przedmiotów ścisłych. Użytkownicy mogą otwierać pliki w formacie Braille Ready Format (BRF) bezpośrednio z poziomu „Braille Access”, odblokowując w ten sposób szeroką gamę książek i plików utworzonych wcześniej na urządzeniach obsługujących robienie notatek brajlem. Dzięki zintegrowanej wersji „Transkrypcji na żywo” mogą oni transkrybować rozmowy w czasie rzeczywistym bezpośrednio na wyświetlaczach Braille’a.

Accessibility Reader to nowy, systemowy tryb czytania, który ma ułatwiać czytanie tekstów użytkownikom z różnymi niepełnosprawnościami, np. dysleksją lub niedowidzeniem. Dostępna na iPhone'ach, iPadach, komputerach Mac i urządzeniach Apple Vision Pro aplikacja Accessibility Reader oferuje nowe sposoby dostosowywania tekstu i skupiania się na treściach, które chcą przeczytać, dzięki wielu opcjom czcionek, kolorów i odstępów, a także obsłudze funkcji „Czytaj treść na głos”. Aplikację Accessibility Reader można uruchomić z dowolnej aplikacji. Jest ona wbudowana w aplikację Lens na systemy iOS, iPadOS i macOS. Umożliwia ona użytkownikom interakcję z tekstem w świecie rzeczywistym, na przykład z książkami lub menu w restauracjach.

Funkcja Live Listen została stworzona z myślą o osobach głuchych i niedosłyszących. Teraz możesz korzystać z niej na Apple Watch, gdzie znajdziesz nowy zestaw funkcji, w tym transkrypcje na żywo. Funkcja Live Listen zmienia iPhone'a w zdalny mikrofon umożliwiający strumieniowe przesyłanie treści bezpośrednio do słuchawek AirPods, Beats lub aparatów słuchowych Made for iPhone. Gdy sesja jest aktywna na iPhonie, użytkownicy mogą przeglądać „transkrypcje na żywo” treści wykrytych przez iPhone’a na sparowanym Apple Watch, jednocześnie słuchając dźwięku. Apple Watch pełni funkcję pilota pozwalającego na rozpoczynanie i zatrzymywanie sesji Live Listen, a także pozwala powrócić do sesji i nadrobić zaległości. Dzięki Apple Watch użytkownicy mogą sterować sesjami Live Listen z drugiego końca pokoju, bez konieczności wstawania w trakcie spotkania lub wykładu.

W przypadku osób niewidomych lub słabowidzących system visionOS rozszerzy funkcje ułatwień dostępu dla osób niewidomych, wykorzystując zaawansowany system kamer w systemie Apple Vision Pro. Dzięki znaczącym udoskonaleniom aplikacji Zoom użytkownicy będą mogli powiększać dowolne obiekty w zasięgu wzroku, łącznie z otoczeniem, za pomocą głównego aparatu. W przypadku użytkowników funkcji VoiceOver funkcja rozpoznawania w czasie rzeczywistym w systemie visionOS wykorzystuje wbudowane w urządzenie uczenie maszynowe do opisywania otoczenia, znajdowania obiektów, czytania dokumentów i nie tylko.

Wiadomości i spostrzeżenia na temat wydarzeń politycznych, gospodarczych i finansowych.

Zapisać sięilsole24ore