Anthropic, Claude'u eğitmek için sohbetleri kullanacak

Telif hakkı ihlali ve Claude'un siber silah olarak kullanılması suçlamaları yetmedi. Şimdi uzun tartışmalara yol açacağı kesin olan başka bir konu daha var. 28 Eylül'den itibaren Anthropic , yapay zeka modellerini eğitmek ve iyileştirmek için sohbetler ve kodlama oturumları kullanacak. Kullanıcılar bu ayarı istedikleri zaman değiştirebilecekler.

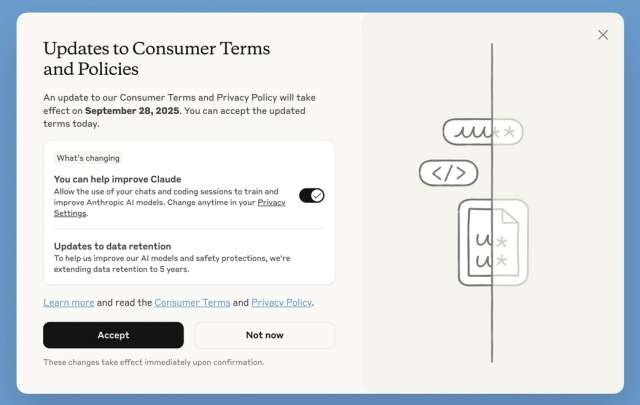

Lütfen gizlilik bildirimine dikkat edinAnthropic, tüm Büyük Dil Modellerinin (LLM) büyük miktarda veriyle eğitildiğini açıklıyor. Sohbet robotlarıyla gerçek zamanlı etkileşimlerden elde edilen veriler en faydalı olanlardır. Bugünden itibaren kullanıcılar, giriş yaptıklarında yeni gizlilik politikasıyla ilgili bir bildirim görecekler. Ekranda, Kaliforniya merkezli girişimin Claude modellerini eğitmek ve geliştirmek için sohbet metni ve kodlama oturumlarını kullanmasına olanak tanıyan seçenek ( zaten seçili ) yer alıyor.

Ekran görüntüsünde görebileceğiniz gibi, Kabul Et düğmesi vurgulanmış, ancak kararınızı ertelemek için Şimdi Değil düğmesine de tıklayabilirsiniz. Kullanıcılar yine de 28 Eylül'e kadar karar vermelidir, aksi takdirde hizmeti kullanamayacaklardır.

Bu ayar, yeni ve geri yüklenen sohbetlerin yanı sıra kodlama oturumları için de geçerlidir. Yeni kullanıcıların kayıt işlemi sırasında seçim yapması gerekecektir. Bu değişiklik Claude Free, Pro ve Max planlarını etkiler (ticari planlar, API erişimi, Amazon Bedrock ve Google Vertex AI etkilenmez).

Bu seçeneği istediğiniz zaman gizlilik ayarlarınızdan işaretini kaldırabilirsiniz, ancak bu seçenek yalnızca gelecekteki sohbetler ve kodlama oturumları için geçerli olacaktır. İptal ederseniz, Anthropic verilerinizi 30 gün boyunca saklamaya devam edecektir. Yapay zeka modellerini eğitmeyi seçerseniz, verileriniz beş yıl boyunca saklanacaktır.

San Francisco merkezli şirket, hassas verilerin otomatik sistemler aracılığıyla gizleneceğini veya filtreleneceğini ve verileri üçüncü taraflara satmayacağını garanti ediyor.

Punto Informatico